-

Vous êtes ici :

- Accueil

- Publications

- Netsources

- Images générées par l’IA : comment les repérer (et pourquoi c’est si compliqué)

Images générées par l’IA : comment les repérer (et pourquoi c’est si compliqué)

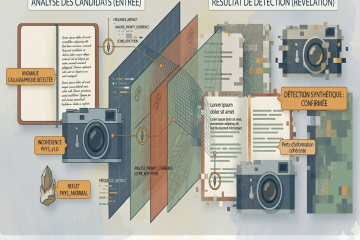

Aujourd’hui, une photo de Donald Trump arrêté par la police peut faire le tour du monde avant que quelqu’un ne se rende compte… qu’elle n’a jamais existé. Les images générées par intelligence artificielle (IA) se multiplient sur les réseaux, parfois pour le divertissement, parfois pour désinformer. Mais une question persiste : comment savoir si une image a été créée par une IA ? Et surtout, pourquoi est-ce devenu si difficile ?

Les outils comme Midjourney, DALL·E ou Stable Diffusion ont démocratisé la création d’images bien avant le fameux Nanobanana de Google/Gemini, qui marque un tournant en combinant des capacités professionnelles à une vitesse de génération «Flash».

En quelques secondes, il suffit de taper une phrase comme “une femme en armure sous la pluie, style réaliste” pour obtenir une image bluffante et hyper réelle. Résultat : n’importe qui peut produire une photo “trop belle pour être vraie”. Et bien souvent, elle l’est. Si ces technologies sont fascinantes pour les artistes ou les créateurs de contenu, elles posent un vrai problème dans un monde où une image suffit à créer le doute : politique, désinformation, fake news… L’IA brouille les frontières entre le réel et le faux.

Des outils pour vérifier

Heureusement, des outils commencent à émerger pour nous aider à distinguer le vrai du faux :

- Google “Recherche d’image inversée” : permet de voir si l’image existe déjà sur le web, ou sous une autre forme.

- Hugging Face“AI or Not” : un détecteur algorithmique qui estime la probabilité d’une génération IA.

- Truepic, Deepware, Illuminarty : des plateformes spécialisées dans la vérification d’images et de deepfakes.

- Watermarks invisibles : certaines entreprises comme OpenAI ajoutent désormais des “signatures numériques” invisibles pour signaler une création IA.

Déjà abonné ? Connectez-vous...

Connexion

Les Tags de Netsources

- IA

- brevets

- cartographie

- SEO

- open access

- livrables de veille

- humain

- médias sociaux

- sourcing veille

- flux RSS

- professionnel de l'information

- open data

- recherche vocale

- information business

- agrégateurs de presse

- à lire

- conférences salons

- information scientifique et technique

- outils de recherche

- outils de veille

- tendances

- multimédia

- actualités

- méthodologie

- serveur de bases de données

- curation

- due diligence

- recherche visuelle

- outils de traduction

- fake news

- fact checking

- publicité

- géolocalisation

- marques

- appels d'offres

- sommaire

- formation Veille Infodoc

- retour d'expérience

- OSINT

- propriété intellectuelle

- presse en ligne

- recherche Web

- évaluation outils

- références bibliographiques

- résumé automatique

- Bing

- veille collaborative

- veille audiovisuelle

- veille innovation

- infobésité

- études de marché

- données statistiques

- dataviz

- information financière

- LexisNexis

- Newsdesk

- sourcing pays

- veille medias

- veille commerciale

- réseaux sociaux

- newsletter

- veille à l'International

- ist

- ChatGPT

- veille métier

- intelligence économique

- veille concurrentielle

- podcast

- science ouverte

- open source

- veille technologique

- knowledge management

- édito

- Intelligence artificielle

- navigateur IA

- sécurité informatique

- navigateur agentique

- méthodologie et livrables

- Deepfakes

- plateforme de veille

- marketing